【摘要】:其中,输入层、隐含层和输出层类似于前馈神经网络,承接层是用来记忆隐含层单元前一时刻的输出值,作为一步延时算子,以达到记忆的目的。w3、w2、w1分别表示隐含层到输出层、输入层到隐层、承接层到隐含层的连接权值。g(.)为输出神经元的传递函数,是隐含层输出的线性组合。

网络简介_认知负荷的评估与变化预测研究

一、Elman网络简介

Elman网络由Elman于1990年提出。该网络在前馈网络基本结构的基础上,在隐含层中增加一个承接层,其结构包括四层:输入层、隐含层、承接层和输出层(见图4.10)。其中,输入层、隐含层和输出层类似于前馈神经网络,承接层是用来记忆隐含层单元前一时刻的输出值,作为一步延时算子,以达到记忆的目的。隐含层的输出通过承接层的延迟与存储,自联到隐含层的输入,这种自联方式使其对历史状态的数据具有敏感性,内部反馈网络的加入增加了网络本身处理动态信息的能力,从而可达到动态建模的目的。

图4.10

Elman神经网络的学习过程为:

Elman网络的非线性状态空间表达式为:

y(k)=g(w3x(k))

x(k)=f(w1xc(k)+w2(u(k-1))

xc(k)=x(k-1)

其中,y,x,u,xc分别表示m维输出神经元向量,n维隐含层神经元向量,r维输入向量和n维反馈状态向量。w3、w2、w1分别表示隐含层到输出层、输入层到隐层、承接层到隐含层的连接权值。g(.)为输出神经元的传递函数,是隐含层输出的线性组合。f(.)为隐含层神经元的传递函数,常采用S型函数。

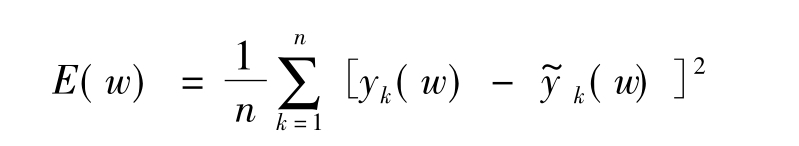

Elman网络也采用BP算法进行权值修正,学习指标函数采用均方误函数:

其中y~k(w)为期望输出向量。

免责声明:以上内容源自网络,版权归原作者所有,如有侵犯您的原创版权请告知,我们将尽快删除相关内容。